AI化身“能耗巨兽”科技大佬同时疾呼“新的能源危机到来”

发布日期:2024/3/9

由美国OpenAI公司最新推出的视频生成工具Sora,自2月16日发布以来,便成为了人工智能界最火爆的“网红”和2024年的开年“顶流”。

OpenAI上一个全网刷屏的现象级产品ChatGPT曾在推出仅两个月后,就达到了1亿月活跃用户数,成为历史上增长最快的消费者应用之一。

而这一次,仅仅靠文字指示,Sora就能生成细节丰富,动作流畅,而且画面连贯的高质量视频,成为了OpenAI继ChatGPT之后新的生成式AI的标杆。

这一轮由Chat GPT掀起的AI大模型热潮里,战况正日趋激烈。就在当地时间3月4日,全球最强大模型已经易主,而OpenAI不可战胜的神话也被打破。当天,OpenAI最强竞对Anthropic最新发布的Claude 3系列模型,在榜单性能跑分上全面超越GPT-4,实现了对GPT-4的全面超越。

但AI背后,是算力,算力背后是能耗。随着算力、性能的不断提升,人工智能飞速发展的背后,能源和水资源的消耗问题也日益凸显,成为了业内关注的焦点。

据国际能源署称,在全球范围内,数据中心目前约占全球用电量的1%至1.5%。全球人工智能领域的蓬勃发展可能会导致这一数字大幅上升,而且速度会很快。与此同时,大量的碳排放和数百万加仑淡水的消耗也不容小觑。

对此,以特斯拉首席执行官埃隆·马斯克、OpenAI首席执行官萨姆·奥特曼为代表的科技大佬们也频频预警人工智能(AI)行业所面临的能源危机。人工智能的能源消耗究竟多大?科技大佬为何同时疾呼“新的能源危机到来”。

图说:3月4日,Anthropic发布Claude 3系列模型

01

人工智能正面临能源危机,电力短缺即将到来

最新的预警来自于马斯克。2月29日,在“博世互联世界2024”大会上,埃隆·马斯克远程接受了博世CEO斯特凡·哈同(Stefan Hartung)和董事长马库斯·海恩(Markus Heyn)的采访,就人工智能议题发表看法。

马斯克表示,芯片短缺的情况可能已经过去,但人工智能和电动汽车正在以如此迅猛的速度扩张,明年全球将面临电力和变压器供应紧张的问题。

图说:2月29日马斯克远程出席“博世互联世界2024”大会

值得注意的是,这已经不是马斯克第一次试图引起业界对于缺电危机的更大关注。

去年以来,马斯克已经多次在各个场合预警可能即将到来的电力短缺。当地时间7月14日,马斯克在xAI公司会议上预测,未来两年将经历从硅料短缺到电压器短缺,再到电力短缺,单位能源有效计算量会是最重要指标。

7月底,马斯克在太平洋瓦电公司PG&E主办的创新峰会上重申,美国2年内将爆发大缺电,到2045年美国的电力消耗将增加2倍,处理不当将阻碍人工智能(AI)、电动车发展机遇。他呼吁电企,尽快提升紧迫感,警告必须采取更快的行动。

今年1月,在瑞士达沃斯举行的年度会议上,OpenAI首席执行官萨姆·奥特曼也终于承认,人工智能(AI)行业正面临能源危机。萨姆·奥特曼警告称,未来人工智能需要能源突破,因为人工智能消耗的电力将远远超出人们的预期。他说:“如果不取得突破,就不可能实现这一目标。”

图说:OpenAI 首席执行官 Sam Altman在沃斯世界经济论坛上发言

02

AI耗能几何?

在过去的两年里,人工智能(AI)迎来了快速扩张,应用场景不断拓展。受 OpenAI 的 ChatGPT成功推出的影响,微软和 Alphabet等知名科技公司在2023 年大幅增加了对人工智能的支持,作为对ChatGPT的回应,Bing Chat和Bard纷纷问世。

这种加速发展引起了人们对人工智能和数据中心的电力消耗和潜在环境影响的担忧。

2023年10月,阿姆斯特丹自由大学商业与经济学院的博士候选人德弗里斯(Alex de Vries) 发表在《焦耳》杂志上的一项研究表明,人工智能(AI)对环境的影响可能比之前认为的要大。研究发现,随着人工智能崛起,到了2027年,AI服务器所消耗的用电量将等同于荷兰全国的能源需求量,这可能会破坏全球减少碳排放的努力。

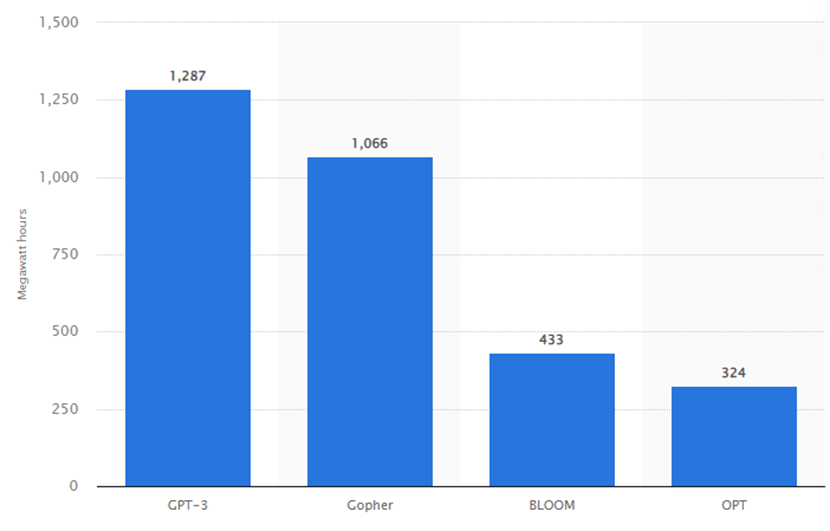

图说:2022年训练基于AI的大型语言模型时的能源消耗(单位:MWh)

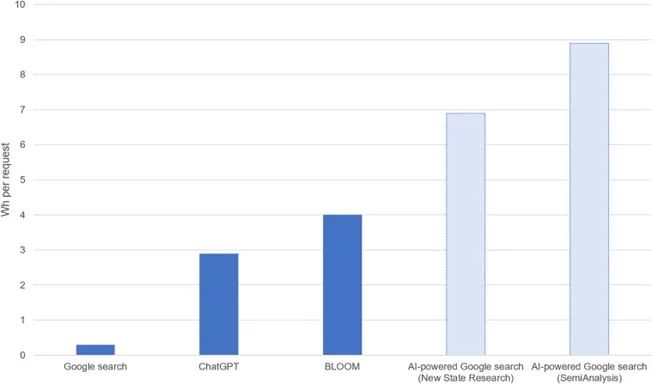

德弗里斯在他的研究中解释道,像ChatGPT这样的大型语言模型(LLM)需要大量的数据集来训练人工智能。他称,“如果你要花费大量资源,建立这些真正的大型模型,并尝试运营一段时间,那将是潜在的巨大能源浪费。” Alphabet 董事长也曾在2023 年2月表示,与LLM 交互的成本可能是标准关键字搜索的10倍。据报道,标准Google搜索使用0.3Wh电力,这表明每次 LLM 交互的电力消耗约为3Wh。

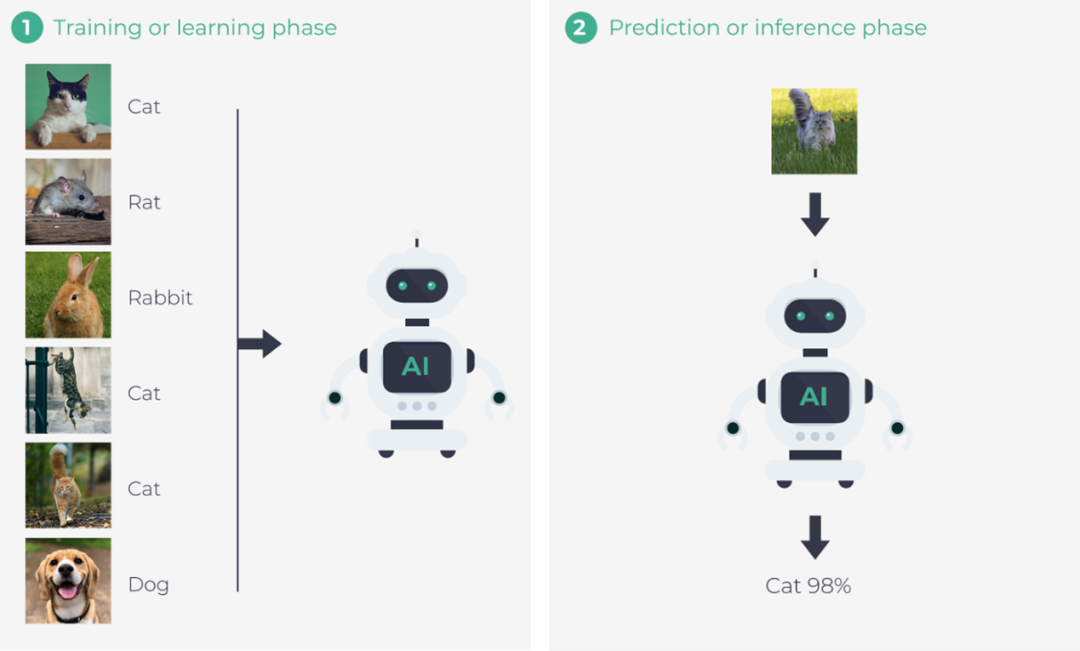

人工智能(AI)是指使机器表现出智能行为的一系列技术和方法。在该领域中,用于创建新内容的生成式人工智能则是典型代表,无论是文本生成工具 ChatGPT、图像生成工具DALL-E还是最近爆火的视频生成工具Sora,均使用了自然语言处理技术,并包括训练阶段(training phase)和推理阶段(inference phase)两大部分。这两阶段都有高密集的能源需求,然而目前尚不清楚各阶段的耗能占比。

图说:人工智能创建涉及的两个阶段:训练阶段和推理阶段

在训练阶段,人工智能模型(如 ChatGPT 的模型)被输入大型数据集进行训练,程序将对模型最初的任意参数进行调整,使预测输出与目标输出接近。每个大预言模型(LLM)都是在TB级数据基础上进行训练的,拥有1,750亿或更多参数。Hugging Face报告称,其 BigScience Large Open-Science Open-Access Multilingual (BLOOM) 模型在训练过程中消耗了433兆瓦时电力,而GPT-3和Gopher仅仅用于训练就消耗了超过1000兆瓦时的能量。

训练结束后,模型将被部署到生产环境中,并开始推理阶段,根据新数据生成输出结果。研究公司 SemiAnalysis 指出,OpenAI需要3,617台英伟达公司的HGX A100服务器(共有28,936个图形处理单元 (GPU))来支持 ChatGPT,这意味着每天的能源需求为 564 兆瓦时,这要比训练阶段的能源需求高得多。此外,谷歌也报告称,从 2019年到 2021年,人工智能相关能源消耗的60%来自推理。然而,来自 Hugging Face的对比数据表明,BLOOM模型在推理阶段的能耗明显低于训练阶段。

德弗里斯在论文中指出,如果将生成式人工智能集成到谷歌的每一个搜索中,那么届时谷歌就会大幅增加对电力的需求。

图说:与标准 Google 搜索相比,各种人工智能驱动系统的每个请求的估计能耗。

据SemiAnalysis 估算,在每次谷歌搜索中实施类似 ChatGPT的人工智能将需要51.28万个英伟达A100 HGX服务器,总计410.26万个GPU,如果每台服务器的电力需求为6.5千瓦,这将相当于每天80吉瓦时的电力消耗和每年29.2太瓦时的电力消耗。

另一家研究机构New Street Research也得出了类似的估计,其认为谷歌将需要大约40万台服务器,这将导致每天消耗62.4吉瓦时,每年消耗22.8太瓦时的能源。

在此项研究中,德弗里斯还根据英伟达的AI芯片销售状况等参数对全球人工智能相关电力消耗进行了预测,他估计,到2027年,全球新制造的服务器与人工智能相关的电力消耗可能会增加到85.4-134.0 太瓦时(850~1340亿度电),这个数字与荷兰、阿根廷和瑞典等国家的年用电量相当,约占全球当前用电量的0.5%。

无独有偶,法国施耐德电气公司去年10 月估计,目前用于人工智能应用的数据中心的总能耗与塞浦路斯全国的能耗相当。微软数据中心技术治理和战略首席电气工程师Paul Churnock预计,到2024年底,部署数以百万计的英伟达H100 GPU时,英伟达的H100 GPU的能耗将超过亚利桑那州凤凰城所有家庭的能耗。

03

不但耗电,而且费水

人工智能除了耗电量惊人,同时还非常耗水。

无论是训练阶段还是推理阶段,人工智能都离不开大规模的数据中心。而数据中心服务器运行的过程中会产生大量热量,水冷是服务器最普遍的方法,这就导致了巨大的水资源消耗。

弗吉尼亚理工大学研究指出,数据中心每天平均必须耗费401吨水进行冷却,约合10万个家庭用水量。Meta在2022年使用了超过260万立方米(约6.97亿加仑)的水,主要用于数据中心。微软在其最新的环境报告中透露,2022年公司用水量同比去年激增了34%,达到640万立方米,比2500个奥林匹克标准游泳池的水量还多。谷歌发布的2023年环境报告同样显示,其2022年消耗的水量高达212亿升,比上一年增加了 20%,其中有约196亿升的水用于数据中心。

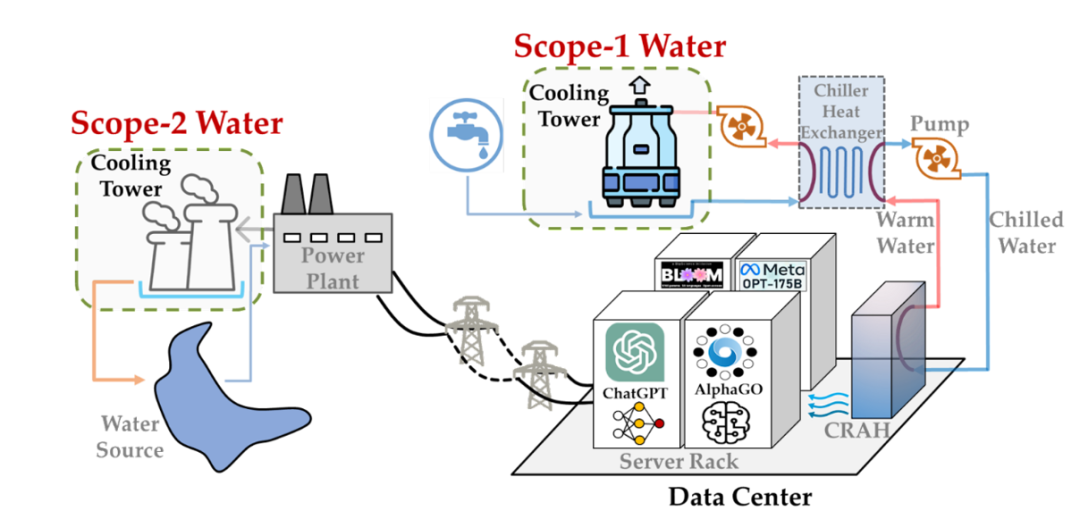

图说:数据中心用水示意图

加州大学河滨分校电气与计算机工程系副教授任绍磊(ShaoleiRen)自2013年起就开始研究人工智能的用水问题。在其去年10月发表的论文中,任绍磊指出,人工智能主要通过现场服务器冷却(范围 1)和场外发电(范围 2)两种方式消耗水。在微软全球数据中心,平均来算大概每用一度电就要蒸发掉一升水,这一升水还只是数据中心直接用水。为了产生这一度电,在发电环节还要消耗大量的水。按照业界平均水平,每发一度电要消耗大约3-6升水。

除了运营过程中范围1和范围2消耗水,人工智能供应链还存在范围3的水消耗。制造人工智能所需的芯片的过程中,也将消耗大量的能源和水资源。硅片工艺需要“超纯水”清洗,且芯片制程越高,耗水越多。生产一个2克重的计算机芯片,大约需要32公斤水。制造8寸晶圆,每小时耗水约250吨,12英寸晶圆则可达500吨。

图说:训练GPT-3耗费的清洁淡水量与其他活动耗水量的对比

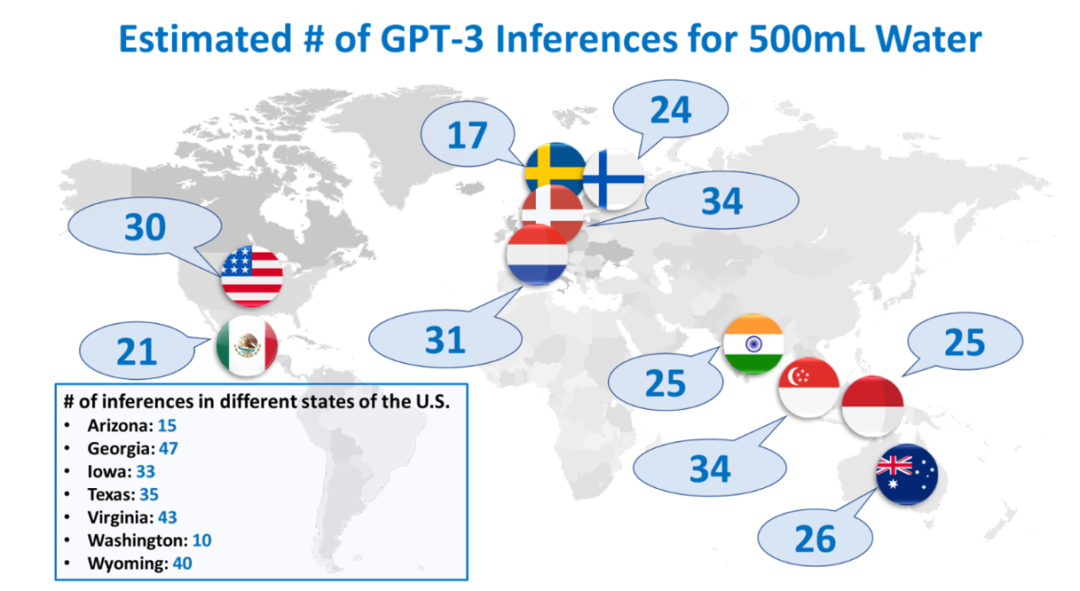

任绍磊(ShaoleiRen)在其论文中指出,在微软最先进的美国数据中心训练 GPT-3总共会消耗 540 万公升的清洁淡水,其中包括 70 万公升的范围-1 现场水消耗。经过测算,GPT-3每进行10-50次的基本询问对话,就需要消耗500毫升的水,具体取决于部署的时间和地点。也就是说,每一次询问对话,它至少要“喝”10毫升以上的水。

图说:全球不同地区每 500mL用水量(范围1和范围2)的GPT-3 推断数量

对于未来,任绍磊的团队预计,到2027年,全球人工智能可能需要4.2-66亿立方米的清洁淡水量,这比4-6个丹麦或一半英国的年取水总量还要多。如果美国承载着全球一半的人工智能工作量,那么人工智能的运行可能会占用其每年总取水量的约0.5%至0.7%。同时,全球人工智能范围1和范围2的总耗水量可能超过0.38-6亿立方米,即大约相当于丹麦一半的年取水量或2.5-3.5个利比里亚的年取水量。

图说:预计2027年全球人工智能用水量

04

写在最后

在这一波由OpenAI引领的人工智能浪潮中,AI 大模型席卷了整个科技领域,在办公、医疗、金融、教育等行业中,基于AI大模型新型应用也层出不穷,给社会经济发展带来了新的助力。

但是不可否认的是,就像AI给人类社会带来效率提升的同时也带来治理和道德危机一样,人工智能的发展需要耗费大量能源和水资源,甚至可能引发新一轮的能源危机。

而这一问题,依然只能从技术层面来根本性地解决,新的能源资源解决方案,比如,核聚变技术,小型模块化反应堆(SMR)正在为科技巨头们带来新的希望。

来源:环球零碳